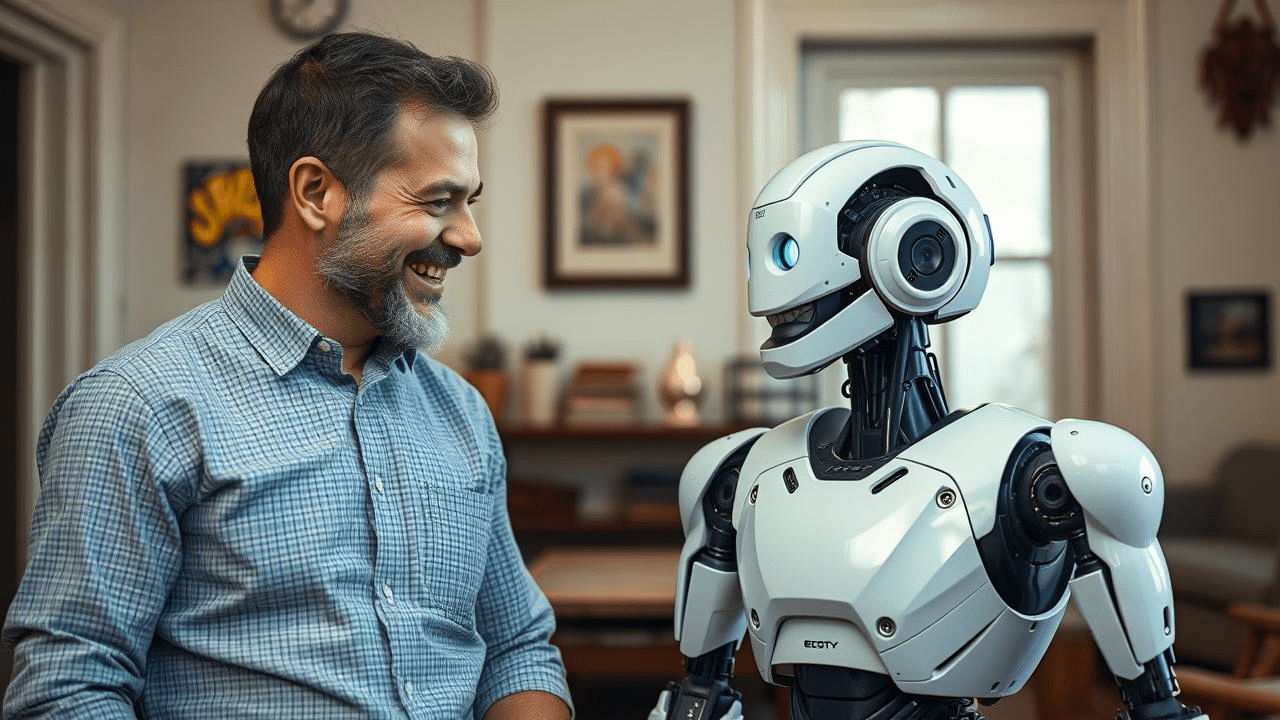

S rozvojem umělé inteligence (AI) se stále častěji setkáváme s otázkami o jejích schopnostech a limitech. Jednou z nejzajímavějších a zároveň potenciálně znepokojujících je otázka, zda může AI vtipkovat a úmyslně uvádět nepravdivé informace. Stručně řečeno, může AI lhát?

Co je to humor a kde se bere?

Než se vrhneme na AI, je důležité pochopit, co vlastně humor je. Humor je komplexní fenomén, který se opírá o narušení očekávání, kontrasty, absurdity a v neposlední řadě o kontext. Vytvoření a pochopení vtipu vyžaduje schopnost rozeznat a interpretovat tyto prvky a současně pochopit, že daný výrok není míněn doslova. Zásadní je i sociální aspekt – vtip je často sdílená zkušenost, která posiluje pouto mezi lidmi.

AI a simulace humoru

Dnešní AI, zejména velké jazykové modely (LLM), jsou schopny generovat text, který se v určitých případech může zdát vtipný. Dělají to tak, že analyzují obrovské množství dat a učí se rozpoznávat vzory v lidském humoru. Jsou schopny kombinovat slova a fráze neočekávanými způsoby, což může vést k komickým výsledkům. Typický příklad je generování „dad jokes“ nebo parodií.

Nicméně, je důležité si uvědomit, že AI v tomto procesu není skutečně vtipná v lidském smyslu. AI nerozumí proč je něco vtipné, pouze automaticky generuje text, který splňuje definované vzory humoru. Neexistuje žádný subjektivní prožitek ani pochopení sociálního kontextu.

Lže AI? A co dezinformace?

Otázka lhaní je ještě komplikovanější. Lhaní vyžaduje úmysl uvést někoho v omyl. AI, jak ji chápeme dnes, nemá vědomí ani úmysl. AI generuje text na základě algoritmů a dat, kterými byla trénována. Pokud AI uvede nepravdivé informace, nedělá to s cílem podvést, ale spíše proto, že daná informace vychází z nekompletních nebo zkreslených dat, nebo z chybného programování.

Přesto je nutné si uvědomit, že AI může produkovat dezinformace. Pokud je AI trénována na datech, která obsahují nepravdivé informace, může tyto informace reprodukovat a dále šířit. Toto je obrovský problém, zejména v kontextu politických kampaní, konspiračních teorií a online podvodů.

Potenciální rizika a etické aspekty:

- Dezinformace a propaganda: AI může být využita k vytváření falešných zpráv a propagandistických materiálů, které mohou ovlivnit veřejné mínění a narušit demokracii.

- Podvody a phishing: AI může generovat realistické phishingové e-maily a podvody, které je pro lidi obtížné rozpoznat.

- Ztráta důvěry: Šíření nepravdivých informací pomocí AI může vést ke ztrátě důvěry v informace obecně.

Jak se s tím vypořádat?

Je zřejmé, že s rostoucí silou AI přichází velká zodpovědnost. Je nutné:

- Vyvíjet etické směrnice pro vývoj a používání AI: Zajistit, aby AI byla používána zodpovědně a v souladu s lidskými hodnotami.

- Zlepšovat kvalitu trénovacích dat AI: Očistit trénovací data od nepravdivých a zavádějících informací.

- Vyvíjet nástroje pro detekci dezinformací generovaných AI: Pomoci uživatelům rozpoznat falešné zprávy a podvody.

- Vzdělávat veřejnost o potenciálních rizicích AI: Zvýšit povědomí o tom, jak rozpoznat dezinformace online.

A co do budoucna?

Ačkoliv AI v současné době není schopna „žertovat“ v lidském slova smyslu, ani úmyslně „lhát“, je schopna generovat text, který může mít obojí dopad. Zneužití AI k šíření dezinformací představuje reálné a rostoucí riziko. Proto je důležité se aktivně zabývat etickými aspekty vývoje a používání AI a vyvíjet nástroje a strategie pro boj proti dezinformacím. Budoucnost, ve které dokážeme rozlišit upřímný humor od manipulativní fabulace generované strojově, je klíčová pro zachování důvěry a zdravé společnosti.